01 Papiereinführung

Additive Fertigung (AM) als Kernrichtung fortschrittlicher Fertigungstechnologie bietet erhebliche Vorteile bei der kundenspezifischen Produktion von Metallkomponenten und der Herstellung komplexer Strukturen. Während des Metall-AM-Prozesses führt die komplexe Wechselwirkung zwischen Laser und Material jedoch leicht zu Defekten wie Spritzern und Porosität aufgrund eines Ungleichgewichts der Energieabsorption, was seine hochpräzise industrielle Anwendung einschränkt. Die Laserabsorptionsfähigkeit als Schlüsselparameter, der den Laserenergieeintrag und die Materialreaktion verknüpft, ist entscheidend für die Überwindung dieses Engpasses durch präzise Quantifizierung und Echtzeitvorhersage. Die Laserabsorptionsfähigkeit bestimmt direkt die Temperaturverteilung des Schmelzbades; Ein zu hohes Absorptionsvermögen kann zu Spritzern führen, während ein zu niedriges Absorptionsvermögen zu fehlenden--Fusionsdefekten führen kann. Um dieses Problem anzugehen, können Deep-Learning-Algorithmen eingeführt werden, die ihre leistungsstarken nichtlinearen Mapping- und Bildmerkmalsextraktionsfunktionen nutzen. Unter Verwendung synchronisierter In-situ-Röntgenaufnahmen von Schlüssellochkollaps-Experimenten (einschließlich der entsprechenden gemessenen Absorptionsfähigkeit) als Kerndaten können geeignete neuronale Faltungsnetze (ResNet-50, ConvNeXt-T), semantische Segmentierungsmodelle (UNet) und Transferlernstrategien entworfen werden, um Merkmale zu extrahieren, die stark mit den geometrischen Eigenschaften des Schlüssellochkollapses (Tiefe, Seitenverhältnis usw.) und der Absorptionsfähigkeit korrelieren. Dadurch kann ein genaues Vorhersagemodell der „Röntgenbild-zu-Laser-Absorptivität“ erstellt werden (sowohl End-zu-Ansätze als auch modulare Ansätze), die eine Echtzeitquantifizierung der Laserabsorptionsfähigkeit ermöglichen und Datenunterstützung für die Steuerung der Schmelzbaddynamik und die Reduzierung von Defekten bereitstellen und so die hochpräzise industrielle Anwendung der Metall-AM vorantreiben.

02 Volltextübersicht

In diesem Artikel werden Absorptions- und Segmentierungsdatensätze unter Verwendung von Daten erstellt, die von einem synchronen Hochgeschwindigkeits-Röntgenbildgebungssystem an der 32{4}ID-B-Strahllinie der Advanced Photon Source (APS) am ANL erhalten wurden, einschließlich Datensätzen ohne Pulverschicht, mit Pulverschicht und mit Dampfdepressionssegmentierung, die jeweils auf End-to--Methoden und modulare Methoden angewendet wurden. Die End-to-End-Methode verwendet zwei Faltungs-Neuronale Netze, ResNet-50 und ConvNeXt-T, um automatisch implizite Merkmale direkt aus vor-verarbeiteten Röntgenbildern zu lernen und die Absorptionsrate über eine vollständig verbundene Regressionsschicht auszugeben, wobei ConvNeXt-T vor-auf ImageNet trainiert wurde und dies anzeigt beste Leistung, wobei ein Testverlust von 2,35 ± 0,35 und ein durchschnittlicher absoluter Fehler von weniger als 3,3 % beim pulver-freien Ti-6Al-4V-Testsatz erreicht wurden. Die modulare Methode extrahiert zunächst geometrische Merkmale der Dampfdepression (wie Tiefe, Fläche und Seitenverhältnis) mithilfe eines semantischen Segmentierungsmodells von UNet und sagt dann die Absorptionsrate mithilfe klassischer Regressionsmodelle wie Random Forest voraus; UNet erreichte bei Segmentierungsaufgaben mit mehreren Materialien (z. B. Ti64, SS316, IN718) den höchsten Testdurchschnitt über der Union (mIoU) von 93,5 %, und das Random Forest-Modell hatte einen Testverlust von 3,30 ± 0,02. Unter anderem ist die End-to-End-Methode hochgradig automatisiert und schnell in der Inferenz, geeignet für die industrielle Echtzeitüberwachung, weist jedoch eine schwache Interpretierbarkeit und größere Vorhersagefehler für Leitungsmuster (kleine Dampfdepressionen) auf; Die modulare Methode weist eine gute Interpretierbarkeit auf (Quantifizierung der Merkmalsbedeutung anhand von SHAP-Werten, eindeutige Identifizierung von Seitenverhältnis, Tiefe und Fläche als Schlüsselmerkmale), beruht jedoch auf einer präzisen Segmentierung und ist in pulverhaltigen Szenarien aufgrund der Schwierigkeit bei der Identifizierung von Vertiefungsgrenzen nur begrenzt anwendbar.

Abbildung 03 zeigt die grafische Analyse.

Abbildung 1 zeigt die vorhergesagten Ergebnisse der Laserabsorption ohne Pulverschicht. Die Unterfiguren a und b verwenden das End-to-End-ResNet-50-Modell, das die Änderungen der Laserabsorptionsrate während des Scannens und Trends in der Deep-Keyhole-Stufe des stationären Lasers genau verfolgen kann, in den ersten beiden Stufen des stationären Lasers treten jedoch große Fehler auf. Die Unterfiguren c und d verwenden das End-{7}bis-End-ConvNeXt-T-Modell mit Scan-Laser-Szenariofehlern von weniger als 3 % und können auch das flache Schlüssellochstadium des stationären Lasers genau vorhersagen, mit Abweichungen nur im No-Depression-Stadium. Die Unterfiguren e und f verwenden einen modularen Ansatz (UNet + Random Forest), mit einer Leistung beim Scannen von Lasern nahe der End-zu-End-Methode; In der Phase ohne Vertiefung des stationären Lasers wird die Vorhersage jedoch als 0 segmentiert (sehr große Abweichung) und die Genauigkeit verbessert sich, nachdem sich das flache Schlüsselloch gebildet hat.

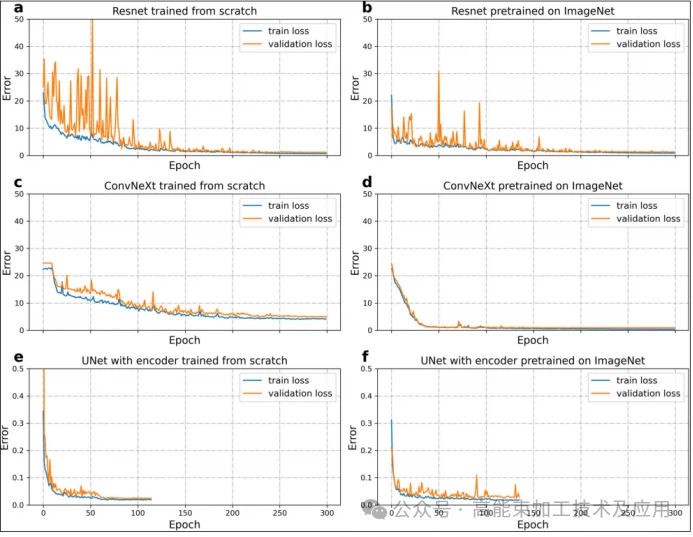

Abbildung 2 zeigt die Trainingsleistung verschiedener Modelle, wobei das vorab trainierte End-bis-ResNet-50-Modell (ImageNet-Gewichte) die Anzahl der Konvergenzepochen im Vergleich zur zufälligen Initialisierung um 19 % reduziert, wobei der Verlust leicht abnimmt 69 % Reduzierung der Konvergenz-Epochen und eine erhebliche Verringerung des Verlusts (Testverlust um 76 % reduziert), während das Vor-Training des UNet-Segmentierungsmodells die Konvergenz-Epochen nur um 16 % reduziert, mit minimalen Auswirkungen auf den Verlust. Diese Abbildung zeigt deutlich, dass vor-trainierte Gewichte die Optimierung von End-to-Endmodellen (insbesondere ConvNeXt-T) erheblich verbessern, aber nur begrenzte Auswirkungen auf Segmentierungsmodelle haben, was eine wichtige Orientierungshilfe für die Auswahl der Modelltrainingsstrategie darstellt.

Figure 3 presents explanations and error analysis centered on the ConvNeXt-T model, comprising three subfigures: Subfigure a shows the attention distribution at different convolution stages through Grad-CAM heatmaps, illustrating the transition from dispersed attention in shallow layers to focused attention on the core region of the steam depression in deep layers, confirming the effectiveness of the end-to-end model in autonomously extracting key features; Subfigure b uses a 40% laser absorption rate as the threshold (distinguishing between conduction mode and keyhole mode) to analyse that samples with an absorption rate >40 % (Schlüssellochmodus) haben einen Vorhersagefehler von nur 2,54, während Proben kleiner oder gleich 40 % (Leitungsmodus) einen Fehler von 12,6 haben, was den erheblichen Fehler des Modells im Leitungsmodus hervorhebt; Unterabbildung c bestätigt durch statische Laserexperimente bei 94 W (geringe Leistung, Leitungsmodus) und 106 W (höhere Leistung, Schlüssellochmodus) weiter, dass die Vorhersagen des Modells den tatsächlichen Werten im Schlüssellochmodus weitgehend entsprechen, tatsächliche Schwankungen im Leitungsmodus jedoch nicht erfassen, was die Ergebnisse von Unterabbildung b bestätigt.

04 Fazit

Die Studie konzentriert sich auf die sofortige Vorhersage des Laserabsorptionsvermögens in der additiven Metallfertigung. Basierend auf Synchrotron-Röntgenbildgebung und Ulbrichtkugel-Strahlungsmessungen wurden Datensätze der Ti-6Al-4V-Absorptionsfähigkeit ohne und mit Pulver sowie Schlüssellochsegmentierungsdatensätze aus mehreren Materialien erstellt. Es wurden zwei Deep-Learning-Methoden vorgeschlagen: End-to-End (ResNet-50, ConvNeXt-T) und modular (UNet + Random Forest), die beide mit MAE hochpräzise Vorhersagen erzielen<3.3%, among which the pre-trained ConvNeXt-T end-to-end model performed best (test loss 2.35±0.35). ImageNet pre-trained weights significantly improved the convergence speed and accuracy of end-to-end models (ConvNeXt-T convergence rounds reduced by 69%, test loss reduced by 76%). Fine-tuning with a small amount of powder-containing data (5%) can effectively adapt to industrial scenarios. The end-to-end method is suitable for industrial real-time monitoring, while the modular method (explicitly considering aspect ratio, depth, and area as key features) is suitable for academic research and offline analysis.